具身智能基础路线

词汇表¶

| 常见关键词 | 释义 |

|---|---|

| End-effector | 末端执行器(夹爪) |

| Teleoperation | 遥操作(人控制机器人) |

| Demonstration | 演示(人教机器人的数据) |

| Augmentation | 增强(数据扩充) |

| Grounding | 锚定/落地(把抽象概念对应到具体物体) |

| Sim2Real | 仿真到真机(Simulation to Reality) |

什么是具身智能?¶

集成环境理解、智能交互、认知推理、规划执行于一体的系统化方案

- 环境理解(perception): 已有一定成果

- 不仅是看清物体(检测),还要理解物体(分割)

- 利用 CV(计算机视觉)技术,如目标检测、语义分割等

- 智能交互:ASR(语音转文字)-->LLM(大模型理解)-->TTS(文字转语音)

-

认知推理: 大语言模型带来惊喜

- 这是目前的大热门。利用 LLM(大语言模型)内置的 Common Sense (常识) 和逻辑思维,去拆解任务

- 通俗解释:机器人不再是死板执行代码,而是像人一样思考“如果我要切苹果,我得先找到刀”

-

规划执行(planning & Execution):

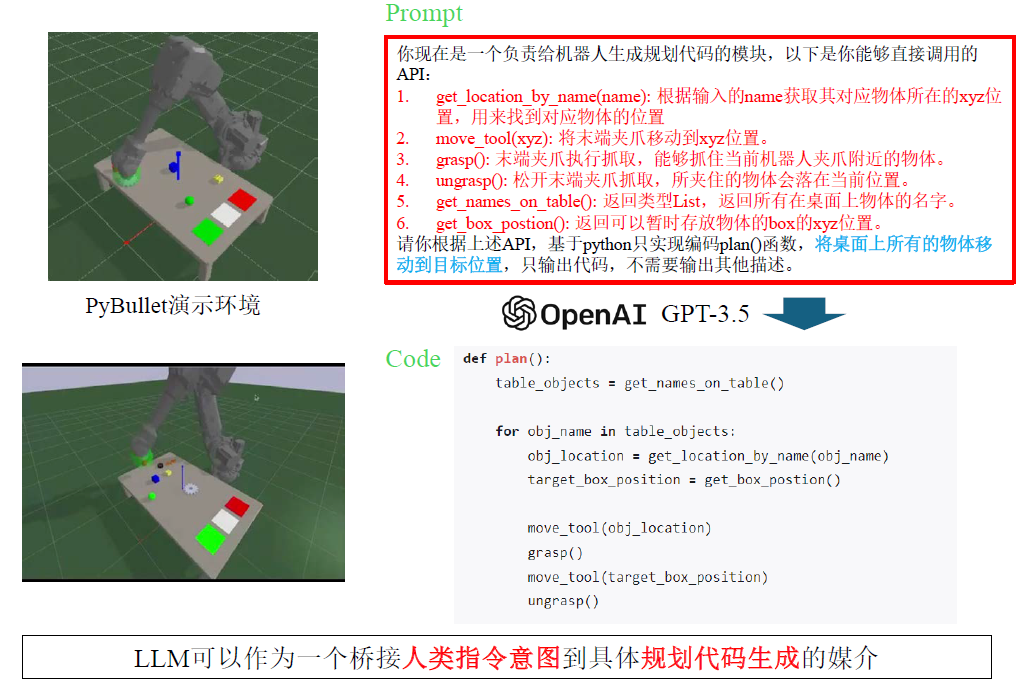

- LLM As General Planner:把大模型当作“大脑”来做顶层规划,从自然语言指令 (Prompt) 生成机器人能执行的代码 (Code)

- 系统化思维:具身智能不是单一模型,而是多个模型(视觉、语言、控制)的有机协作

具身智能的发展¶

LLM As General Planner¶

通过包罗万象的Tokens训练的LLM,其内蕴的Common Sense以及思维逻辑,能够成为面向机器人的General Planner

系统化视角:次系统化思维¶

用非常多的模型去整合成一个系统,才实现一个目标

模型之间的协调、匹配

怎么把上一个模型和下一个模型做一个更好的桥接

基础技术路线¶

1. 场景理解 相对成熟¶

- 检测分割 (为代表的传统的深度学习、CV做的基础性任务)

- 分割:SAM (Segment Anything Model)、Open-Vocabulary Detection (开放词汇检测)、SAM3D(点云 or 激光扫描)

- 检测:Open-Volcabulary(开放词汇检测:找到某个和query中的text最匹配的某个bounding box)

- 多模态定位 (Multimodal Grounding) 更聪明

- Grounding 是把文字(比如“苹果”)和图片中具体的像素区域对应起来

- 多模态(文本、图像)大模型能够实现像素级别(Pixel-level) 的细粒度定位(相对于Bounding box的信息含量更高),表征着大模型的理解能力大幅度提高

- Prompt的多样化(结合bounding box)使得Grounding具有更好的针对性

多模态、多任务赋能的LLM具有更加通用的场景理解能力

2. 数据引导 和纯粹的数据收集区分,因为scale难以达到较大规模¶

机器人领域的最大问题:数据量不够

- 视频学习

- MimicPlay / Vid2Robot:用已有的视频(互联网)提取有用的信息,降低对机器人真机操作的数据需求 提高数据利用效率,减少算法对数据采集效率的依赖

- 局限性:信息表征的完全度,相对于真机的还原性,内在的迁移能力

- 硬件在环采集 (Hardware-in-the-loop)

- Light-weight Hardware:通过轻量级的硬件进行采集

- UMI:舍去机器人庞大的躯干、双臂,只是针对于End-effector (EE,末端执行器,指机械臂最前端的夹爪或工具) 做处理。例如做一个1:1的夹爪,在夹爪中放了多视角的camera。采集的数据训练完了之后部署到真机上

- DexCap:人带上数据手套,再加上两个深度摄像头去做末端的pose去精确捕捉手指末端的3D位置-->通过映射(以及删除小拇指数据)到LEAP Hand(一种灵巧手)-->力运动学 匹配手的尺寸到灵巧手尺寸-->实现双灵巧手

- HIRO Hand:通过抓环和指套,hand to hand(手把手)带着机械臂去完成操作,省去了人手到灵巧手的转换过程,不会失真

- Heavy Hardware:重量级硬件(VR眼镜、VR手套+两个双臂主从的遥操作(Teleoperation)-->双臂灵巧手) 硬件成本高 采集信息效率、信息量多

- Sanctuary AI、Tesla:VR手套把人手的多关节、高自由度的复杂运动做一个采集和映射。在遥操作的时候采集更加丰富的操作数据(相较于UMI)

- Light-weight Hardware:通过轻量级的硬件进行采集

- 生成式仿真 Generative Simulation 深层仿真

- RoboGen:构建闭环自动流程,实现propose任务-->generate任务的场景-->learn训练数据的流程 难以把握可控性

- MimicGen (Demonstration Augmentation (演示数据增强)):用少量的人类演示数据,通过算法自动生成出各种变体(比如改变物体位置、颜色),把 1 条数据变成 100 条用 可控性提升

3.动作执行 机器人“小脑 ”¶

- 生成式模仿学习 Generative Imitation Learning

把state丢进去当成时间序列去处理,输出每个joint的时间序列去完成一个学习- ACT(Action Chunking Transformer):机器人不是想一步走一步,而是预测未来的一整段(一块)动作序列,这样动作更连贯流畅,提高训练效率和稳定性

- Diffusion Policy (扩散策略):

- 先给数据Add Noise (加噪), 再学习如何Denoise (去噪) 还原出动作, 使模态得到提升。把时间序列拆解到每一步,每一步之间做diffusion,最后得到的trajectory作为机器人末端或low level joint

- Prediction Horizon:预测未来 N 步(Prediction Horizon(预测视界)),执行前 k 步(Receding Horizon Control (RHC, 滚动时域控制)) 提高鲁棒性和稳定性

- 可供性 Affordance

上述两个的中间形态表达,- RoboAffordance:在这个输入(2D图片)中,哪一个region(区域或像素点)可以被怎么样操作,被接触后下一步的动作应该是什么 contact point+单方向的 trajectory/vector field

- AffordPose (3D):输入点云,其中的物品的每一个part的可供性都不同,能用来做的事情也不一样,并且标注了灵巧手的自由度

- 大模型问答 Q&A from LLM

通过组织特定的Prompt,从大语言模型中query出一些能够直接用来进行操作的一些关键字符

用大预言模型的理解,及其推理能力提取出机器人最后要走的目标 - 大模型Prompt规划 Prompt Planning from LLM

把大任务拆解成小的 Prompt,再调用机器人底层的 API - Language Correction

人在观察机器人执行的过程中去给出一些语音或文本的提示,去更好地完成任务

4.世界模型¶

为什么世界模型在面向具身智能(包括面向操作的具身智能)是比较重要的?

Simulation 就是某一方向的世界模型

从物体的角度去理解世界和交互是一种很重要的认知能力

世界模型可以去预测机器人和物体的交互 很好的模型预测,实现矫正、选择出最优的action

- 3D VLA:经过一个操作之后,新的点云环境是什么(\(S_t\)在经过一个\(A_t\)之后,\(S_{t+1}\)是什么)

例如:拿开杯子后,桌子露出来了

- LAPO:在环境中往上下左右走,环境会变成什么样

机器人现状 机器人大脑、小脑发展不平衡¶

大脑:模拟人的决策思维过程(理解环境、和人交互,完成动作规划、执行动作)

小脑:完成这些规划指令

多模态大模型稳步推进,但是小脑的灵巧操作能力有待提高,原因:

1. 数据获取的难度

2. 如何设置控制器

manipulation的技术路线还没有统一,没有像transformer一样形成一个大一统的问题